최근 AI 인프라를 담당하는 곳들의 주가가 널뛰고 있습니다. 이는 데이터센터 수요가 폭증했기 때문인데, 이에 관해 한 번 정리해보고자 합니다.

왜 이렇게 막대한 양의 데이터센터가 필요하고 전력이 필요할까요?

현재 왜 그렇게 GPU와 데이터센터에 대해 수요가 쏠릴까?에 대한 근본적인 부분을 살펴보면 다음과 같습니다. 최신 AI가 글을 잘 이해하고, 그림도 그리고, 심지어 코딩까지 하고 있는데 어떤 원리로 이렇게 똑똑해졌을지 살펴보면 그 거대한 발전의 비밀은 세 단계의 이야기로 이루어져 있습니다. '획기적인 공부법의 발견', '엄청난 공부량과 도구', 그리고 마지막으로 '성적이 오르는 마법 공식'의 발견입니다.

획기적인 공부법의 발견: '전화기 게임'에서 '오픈 북 시험'으로

과거의 AI(RNN)는 마치 '전화기 게임'처럼 공부했습니다. 첫 단어부터 순서대로 정보를 속삭이며 전달하다 보니, 문장이 길어지면 맨 처음의 내용이 점점 날아가는 문제가 발생했습니다.

![Deep Learning] RNN 알고리즘 개념 이해](https://blog.kakaocdn.net/dna/dQIPiW/btrHKcZI8NY/AAAAAAAAAAAAAAAAAAAAAIJdUmlM40nQpVjv7rScuJmD-iGnz8fOWLq9NTPksqH5/img.png?credential=yqXZFxpELC7KVnFOS48ylbz2pIh7yKj8&expires=1761922799&allow_ip=&allow_referer=&signature=ioywi7KC9R91XG4%2BhQkL2AxOv1c%3D)

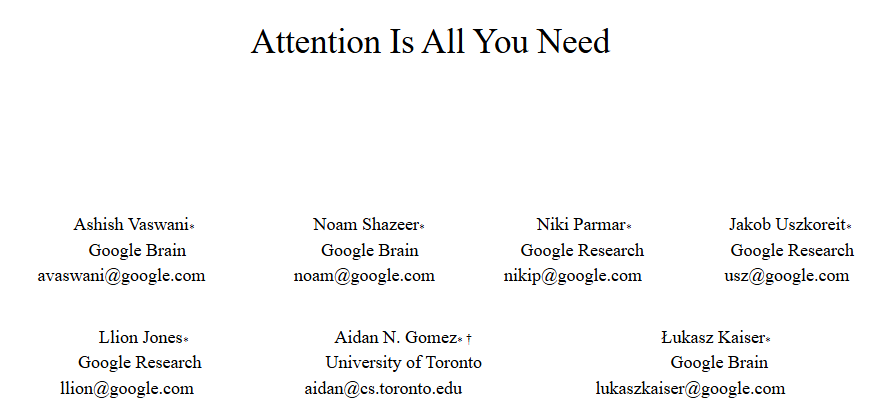

하지만 2017년, 구글 연구진이 발표한 "Attention Is All You Need"라는 논문은 AI 분야의 모든 것을 바꿀 혁신적인 해법을 제시했습니다. "당신에게 필요한 것은 'Attention' 뿐이다"라는 제목은 그 자체로 하나의 선언이었습니다. 이는 더 이상 복잡한 순차 처리 방식 없이 오직 '어텐션' 메커니즘만으로 충분하다는 엄청난 자신감의 표현이었습니다.

이 논문에서 제안된 '트랜스포머(Transformer)' 구조는 그 이름처럼 AI의 패러다임을 완전히 전환시켰으며, 현재까지 약 20만 회 인용될 정도로 학계와 산업에 막대한 영향을 미치고 있습니다.

*GPT(Generative Pre-trained Transformer)

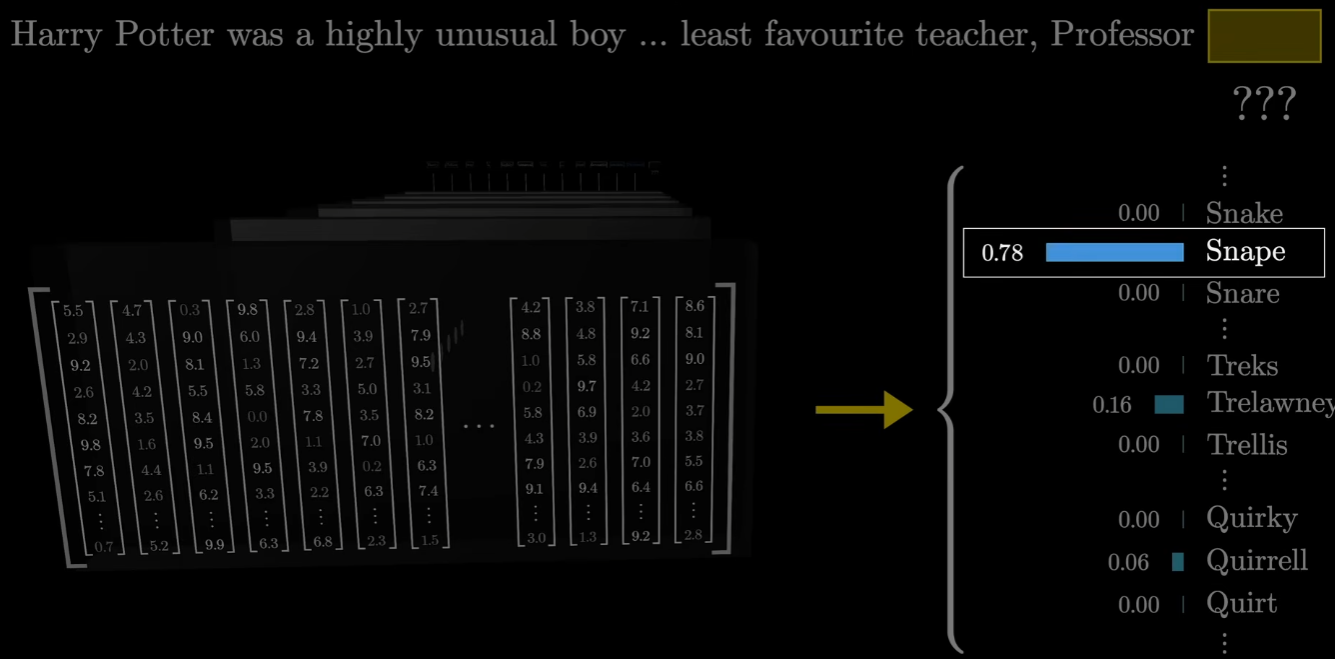

이 새로운 공부법은 '오픈 북 시험'과 같습니다. 정답을 찾아야 할 때, 책(문장 전체)의 모든 페이지(모든 단어)를 한 번에 펼쳐놓고, 문제와 가장 관련 있는 핵심 키워드에만 '집중(Attention)' 하는 방식입니다. 논문 제목처럼, 순차적인 정보 전달 없이 오직 'Attention'만으로도 충분하다는 것을 증명한 것입니다. 이 덕분에 AI는 아무리 긴 글이라도 핵심 의미를 놓치지 않게 되었습니다.

엄청난 공부량과 도구: 계산량 폭증과 해결사 GPU

이 '오픈 북 시험' 공부법은 효과가 확실했지만, 엄청난 노력이 필요했습니다. 모든 단어들이 서로 얼마나 관련 있는지 일일이 다 계산해야 했기 때문이죠. 글의 길이가 2배가 되면, 필요한 계산량은 4배로 폭증했습니다.

이 무지막지한 계산량을 감당하기 위해 나타난 해결사가 바로 GPU입니다. 똑똑한 박사님 한 명(CPU)이 순서대로 푸는 것보다, 수천 명의 일꾼들(GPU)이 단순 계산을 동시에 처리하는 것이 훨씬 빨랐습니다.

'오픈 북 시험(트랜스포머)'이라는 공부법과 '일꾼 군단(GPU)'이라는 도구가 준비된 것입니다.

성적이 오르는 마법 공식: '스케일링 법칙'의 발견

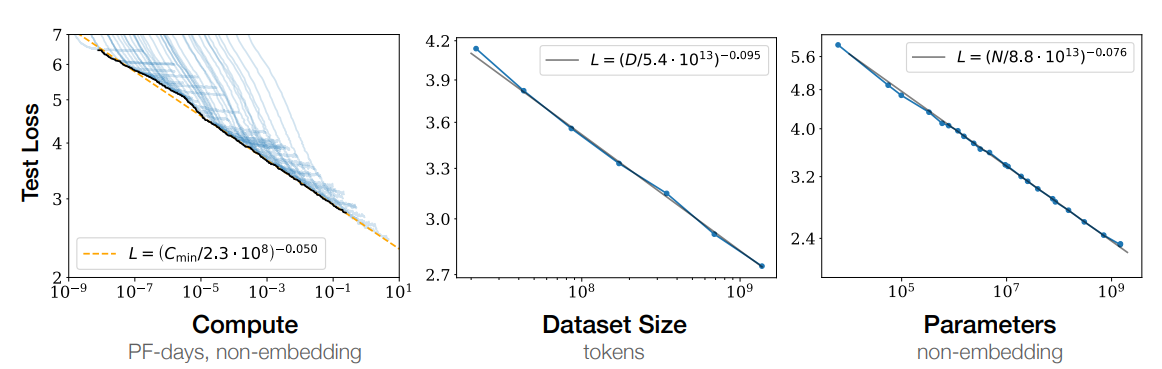

자, 이제 가장 중요한 마지막 단계입니다. 과학자들은 이 새로운 공부법과 도구를 가지고 실험하다가 놀라운 사실을 발견합니다. 바로 AI의 성적을 예측할 수 있는 '마법 공식'을 찾아낸 것입니다. 이 공식이 바로 '스케일링 법칙(Scaling Laws)'입니다.

이 공식의 세 가지 핵심 재료는 다음과 같습니다.

더 큰 두뇌 (모델 크기): AI의 뇌 용량(파라미터)을 늘려 더 복잡한 것을 배울 수 있게 합니다.

더 많은 교과서 (데이터 크기): 인터넷의 모든 글과 책을 읽게 하듯, 학습 자료를 늘려줍니다.

더 많은 공부 시간 (컴퓨팅 파워): 더 많은 GPU를 투입해 이 모든 것을 더 오래, 더 깊게 학습시킵니다.

스케일링 법칙의 진짜 마법은, 이 세 가지 재료를 늘리면 AI의 성능(성적)이 '얼렁뚱땅' 좋아지는 게 아니라, '예측 가능하게' 좋아진다는 점입니다. 마치 '수학 공부 시간을 2배로 늘리면 수학 점수가 10점 오를 거야'라고 미리 알 수 있게 된 것과 같습니다.

이 발견은 AI 개발의 패러다임을 바꾸었습니다. AI를 개발하는 것이 더 이상 '운'이나 '감'의 영역이 아니라, 막대한 자본 투자가 성능 향상으로 이어질 것이라는 '예측 가능성'을 제공하는 '공학'의 영역으로 들어선 것입니다.

이러한 예측 가능성의 핵심 근거가 바로 '스케일링 법칙(Scaling Laws)'입니다. 2020년 OpenAI 연구진은 모델 크기, 데이터양, 그리고 투입되는 컴퓨팅 파워를 늘리면 AI의 성능(손실 값)이 멱함수(power-law)에 따라 예측 가능하게 향상된다는 경험 법칙을 제시했습니다.

이 법칙은 이후 거대 언어 모델 개발의 핵심적인 나침반 역할을 했습니다. OpenAI는 GPT-4 기술 보고서에서, GPT-4 최종 훈련에 사용된 컴퓨팅 파워의 1/1000 미만으로 훈련한 소규모 모델들을 통해 GPT-4의 일부 핵심 성능을 사전에 매우 정확하게 예측했다고 공식적으로 밝혔습니다. '성공이 100% 보장'되는 것은 아니지만, 수조 원대 투자의 불확실성을 크게 줄여주는 강력한 근거가 된 셈입니다.

*GPT-2, 3, 4의 파라미터 수: 15억개 / 1,750억개 / 비공식 추정: 1조 8천억 개

이러한 예측 가능성은 빅테크 기업들의 천문학적인 AI 투자 경쟁에 불을 붙였습니다. 실제로 2025년 마이크로소프트와 구글은 AI 데이터센터 및 서버 확충을 위해 각각 약 800억 달러와 850억 달러에 달하는 대규모 투자 계획을 발표했습니다.

최신 AI의 발전 과정을 가장 정확하게 요약하면 다음과 같습니다.

'전화기 게임(RNN)'의 한계를 → '오픈 북 시험(트랜스포머)'으로 돌파하고 → 그 엄청난 계산량을 'GPU'로 감당하며 → '스케일링 법칙'을 통해 성능 향상의 예측 가능성을 확보하여 → 더 똑똑한 AI를 만들기 위한 거대 자본의 경쟁 시대가 열렸다.

훈련시장보다 훨씬 거대한 추론 시장

그리고 현재 AI 발전의 서사는 새로운 장에 접어들었습니다. '더 똑똑한 모델을 만드는' 훈련(Training)의 시대를 지나, 이제는 ...