Power to the people: How LLMs flip the script on technology diffusion - Karpathy

좋은 글 있어서 공유합니다.

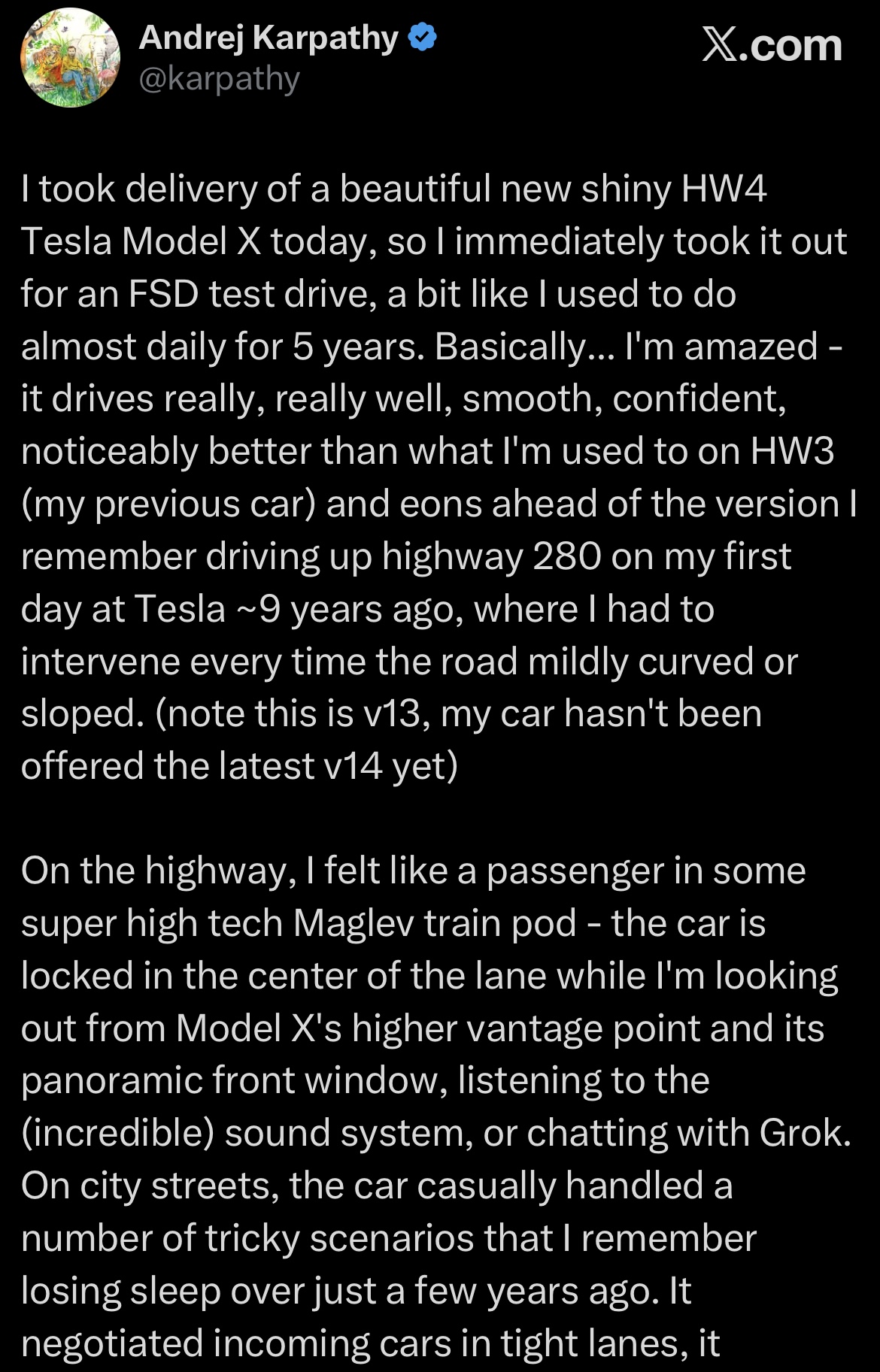

AI 가 개인의 생산성을 높임으로써, AI 스타트업 붐이 생길 것이라는 막연한 생각이 있었는데, 보다 구체화된 생각을 정리한 Andrej Karpathy의 글이 있어 들고 왔습니다.

출처: https://karpathy.bearblog.dev/power-to-the-people/

변혁적인 기술은 일반적으로 상향식 확산 경로를 따릅니다. 이는 정부나 군사적 맥락에서 시작되어 기업을 거쳐 개인에게 도달하는 방식입니다. 전기, 암호학, 컴퓨터, 비행, 인터넷, GPS를 떠올려보세요. 이러한 기술들은 초기 단계에서 희소하고 자본 집약적이며, 전문적인 기술 지식을 필요로 하기 때문에 이러한 진행이 직관적으로 느껴집니다.

하지만 대규모 언어 모델(LLM)은 이 패턴을 극적으로 뒤집는 독특하고 주목할 만한 사례로 보입니다. LLM은 일반 대중에게 불균형적으로 큰 혜택을 제공하는 반면, 기업과 정부에서는 그 영향이 상대적으로 약하거나 더디게 나타납니다. 예를 들어, ChatGPT는 역사상 가장 빠르게 성장한 소비자 애플리케이션으로 주간 활성 사용자 수가 4억 명에 달하며, 글쓰기, 코딩, 번역, 과외, 요약, 심층 연구, 브레인스토밍 등 다양한 용도로 사용됩니다. 이는 기존 기술의 소폭 업그레이드가 아니라 개인의 능력을 여러 방면에서 크게 확장시키는 주요 도구입니다. 사용 장벽도 매우 낮아 무료 또는 저렴하게 제공되며, 누구나 URL이나 로컬 기기를 통해 즉시 사용할 수 있고, 사용자 모국어뿐만 아니라 다양한 언어와 톤까지 지원합니다. 이는 놀라운 변화로, 일반 대중이 이렇게 급격한 기술적 도약을 경험한 적은 없었습니다.

그렇다면 왜 기업과 정부에서는 이러한 혜택이 상대적으로 약할까요? 첫 번째 이유는 LLM이 특정한 능력 프로파일을 제공하기 때문입니다. 이는 넓은 분야에서 준전문가 수준의 성과를 내지만 깊이가 부족하고 오류 가능성이 있다는 점입니다. 반면 조직은 엔지니어, 연구원, 분석가 등 다양한 전문가를 고용해 전문 지식을 집중시키는 것이 강점입니다. LLM은 이 전문가들의 개별 효율성을 높일 수는 있지만(예: 초안 작성, 코드 생성 등), 조직 전체에는 기존 작업의 약간의 개선 정도로만 영향을 미칩니다. 반면 개인은 한두 가지 분야에만 전문성을 갖추고 있는 경우가 많아 LLM이 제공하는 폭넓은 준전문가적 능력은 개인이 이전에는 할 수 없었던 일을 가능하게 합니다.

두 번째 이유는 조직이 훨씬 더 복잡하고 조정이 필요한 문제를 다루기 때문입니다. 예를 들어 통합 시스템, 레거시 시스템, 브랜드 가이드라인 준수, 보안 프로토콜 및 규제 준수 등이 포함됩니다. 이러한 변수와 제약 조건이 많아 단순히 "코드를 작성해보자"는 식으로 해결할 수 없습니다. 한 번의 실수로도 심각한 결과를 초래할 수 있습니다.

세 번째 이유는 조직의 관성입니다. 이는 문화적 요인, 역사적 선례, 정치적 갈등, 커뮤니케이션 비용 증가 및 재교육 문제 등을 포함합니다. 이러한 요인들은 새로운 도구를 신속히 채택하는 데 큰 장애물이 됩니다.

앞으로 LLM의 확산은 성능 개선과 능력 프로파일에 크게 좌우될 것입니다. 현재 최첨단 LLM의 성능은 저렴하고 접근 가능한 상태입니다. 하지만 자본 투자로 더 나은 성능을 얻을 수 있는 시점이 오면 상황이 달라질 것입니다. 대규모 조직은 자원을 집중해 더 나은 인공지능을 구매할 수 있게 되고, 개인 간에도 격차가 발생할 가능성이 있습니다.

현재 우리는 기술 역사상 독특하고 전례 없는 상황에 놓여 있습니다. 과거 공상과학 소설에서는 AI 혁명이 정부의 비밀 프로젝트로 시작될 것이라 예측했지만, 실제로는 ChatGPT가 무료로 모든 사람의 손에 들어오는 방식으로 진행되었습니다. 윌리엄 깁슨의 말처럼 "미래는 이미 와 있다. 단지 고르게 분배되지 않았을 뿐이다." 하지만 이번에는 미래가 놀라울 정도로 고르게 분배되고 있습니다. "사람들에게 권력을!"

원문

Transformative technologies usually follow a top-down diffusion path: originating in government or military contexts, passing through corporations, and eventually reaching individuals - think electricity, cryptography, computers, flight, the internet, or GPS. This progression feels intuitive, new and powerful technologies are usually scarce, capital-intensive, and their use requires specialized technical expertise in the ...