지난 2년간의 엔비디아의 부상은 기술 분야의 위대한 사례 중 하나로 기록될 것입니다.

젠슨은 2006년에 가속 컴퓨팅을 구상했습니다. 그는 2023년 창립 연설에서 “2007년에 우리는 CUDA GPU 가속 컴퓨팅을 발표했습니다. 우리의 포부는 CUDA가 과학 컴퓨팅과 물리 시뮬레이션에서 이미지 처리에 이르는 다양한 애플리케이션을 향상시키는 프로그래밍 모델이 되는 것이었습니다. 새로운 컴퓨팅 모델을 만드는 것은 엄청나게 어렵고 역사상 거의 이루어지지 않았습니다. CPU 컴퓨팅 모델은 IBM System 360 이후 60년 동안 표준이 되어 왔습니다.”

그 후 15년 동안 엔비디아는 그 비전을 실행에 옮겼습니다.

CUDA를 통해 머신 러닝에 GPU를 사용하는 개발자 생태계를 구축했습니다. 멜라녹스를 통해 데이터센터 네트워킹의 선두주자가 되었습니다. 그런 다음 모든 하드웨어를 서버에 통합하여 수직적으로 통합된 컴퓨팅 인 어 박스를 제공했습니다.

AI 열풍이 불기 시작했을 때, 엔비디아는 AI 골드러시에서 독점적인 지위를 누리며 이를 활용할 수 있는 가장 유리한 위치에 있던 회사였습니다.

그 결과 Nvidia는 역사상 가장 성공적인 회사 중 하나로 부상했습니다.

이러한 성장과 함께 가장 큰 고객을 포함한 경쟁이 시작되었습니다. 엔비디아의 지배력을 차지하기 위해 수백억 달러가 생태계에 유입되었습니다.

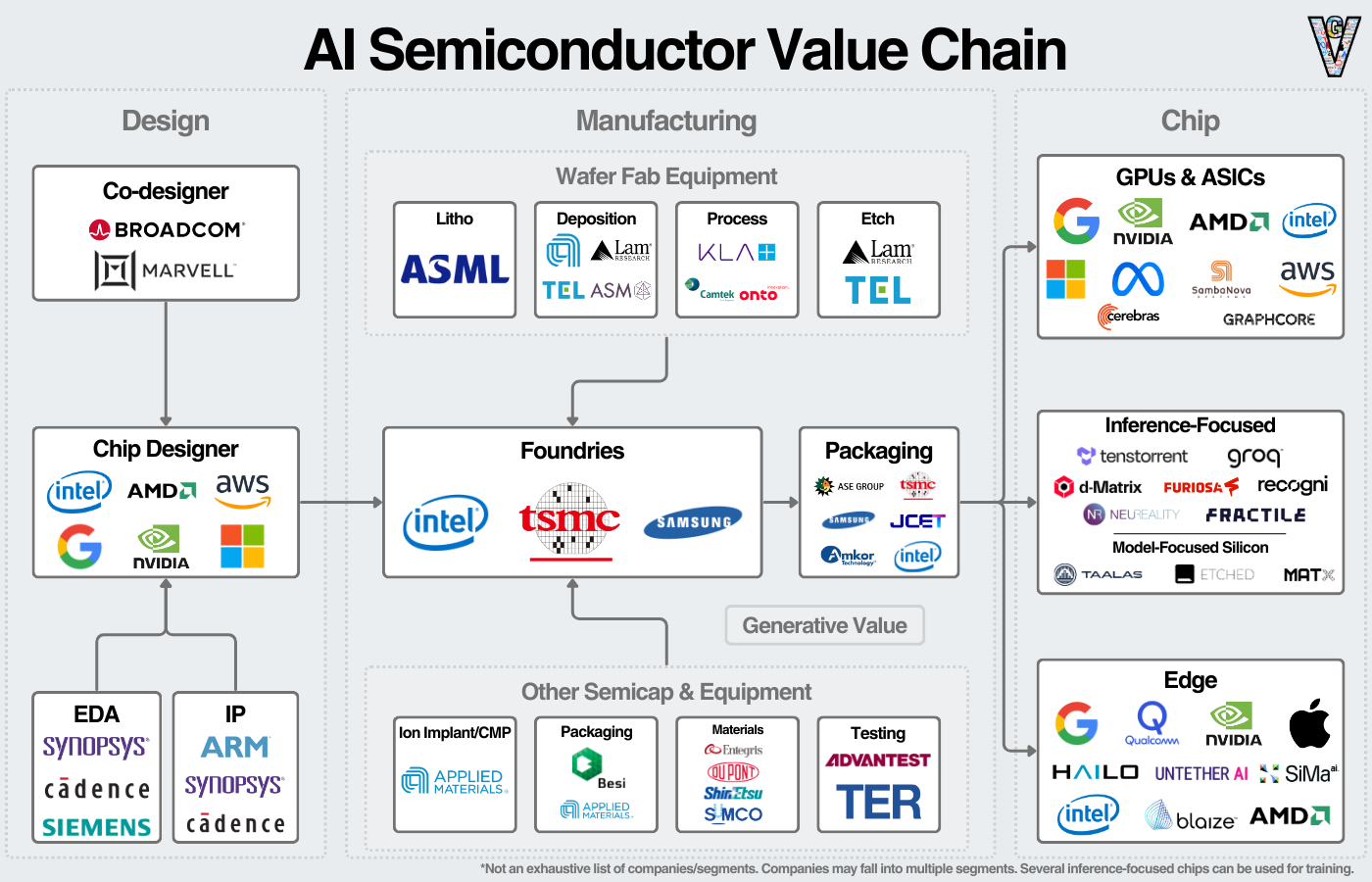

이 글에서는 오늘날의 생태계와 앞으로의 전망에 대해 간략히 살펴보겠습니다. 더 깊이 들어가기 전에 생태계를 어떻게 구성하는지 간략히 살펴보겠습니다:

지난 2년간의 엔비디아의 부상은 기술 분야의 위대한 사례 중 하나로 기록될 것입니다.

젠슨은 2006년에 가속 컴퓨팅을 구상했습니다. 그는 2023년 창립 연설에서 “2007년에 우리는 CUDA GPU 가속 컴퓨팅을 발표했습니다. 우리의 포부는 CUDA가 과학 컴퓨팅과 물리 시뮬레이션에서 이미지 처리에 이르는 다양한 애플리케이션을 향상시키는 프로그래밍 모델이 되는 것이었습니다. 새로운 컴퓨팅 모델을 만드는 것은 엄청나게 어렵고 역사상 거의 이루어지지 않았습니다. CPU 컴퓨팅 모델은 IBM System 360 이후 60년 동안 표준이 되어 왔습니다.”

그 후 15년 동안 엔비디아는 그 비전을 실행에 옮겼습니다.

CUDA를 통해 머신 러닝에 GPU를 사용하는 개발자 생태계를 구축했습니다. 멜라녹스를 통해 데이터센터 네트워킹의 선두주자가 되었습니다. 그런 다음 모든 하드웨어를 서버에 통합하여 수직적으로 통합된 컴퓨팅 인 어 박스를 제공했습니다.

AI 열풍이 불기 시작했을 때, 엔비디아는 AI 골드러시에서 독점적인 지위를 누리며 이를 활용할 수 있는 가장 유리한 위치에 있던 회사였습니다.

그 결과 Nvidia는 역사상 가장 성공적인 회사 중 하나로 부상했습니다.

이러한 성장과 함께 가장 큰 고객을 포함한 경쟁이 시작되었습니다. 엔비디아의 지배력을 차지하기 위해 수백억 달러가 생태계에 유입되었습니다.

이 글에서는 오늘날의 생태계와 앞으로의 전망에 대해 간략히 살펴보겠습니다. 더 깊이 들어가기 전에 생태계를 어떻게 구성하는지 간략히 살펴보겠습니다:

1. AI 가속기에 대한 몇 가지 배경

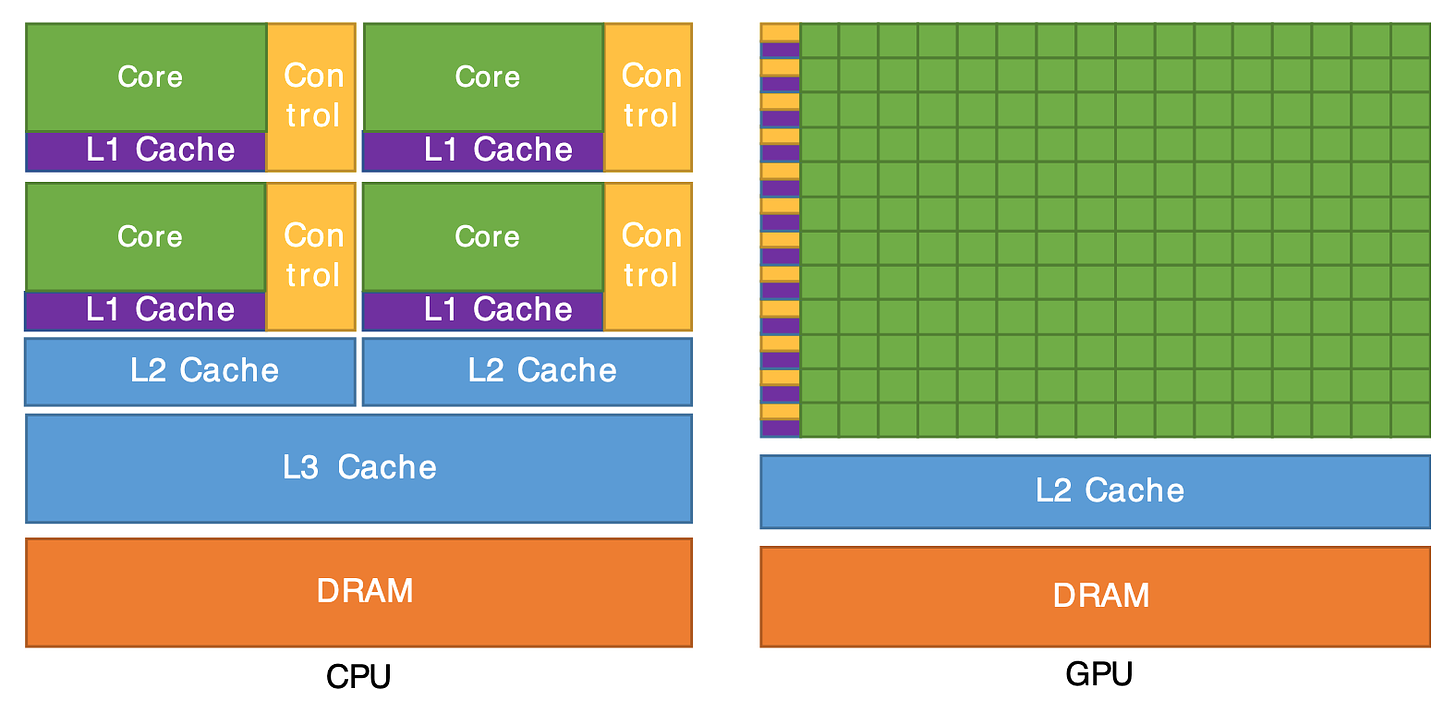

매우 높은 수준에서 모든 논리 반도체에는 다음과 같은 부품이 있습니다:

1. 컴퓨팅 코어 - 실제 컴퓨팅 연산을 실행합니다.

2. 메모리 - 컴퓨팅 코어에 전달할 데이터를 저장합니다.

3. 캐시 - 빠르게 검색할 수 있는 데이터를 임시로 저장합니다.

4. 제어 장치 - 다른 구성 요소의 작업 순서를 제어하고 관리합니다.

전통적으로 CPU는 범용 컴퓨터입니다. 복잡한 다단계 프로세스를 포함한 모든 계산을 실행하도록 설계되었습니다. 아래 그림과 같이 더 많은 캐시, 더 많은 제어 장치, 훨씬 더 작은 코어(CPU의 산술 논리 장치 또는 ALU)를 갖추고 있습니다.

반면에 GPU는 많은 소규모 계산 또는 병렬 처리를 위해 설계되었습니다. 처음에 GPU는 디스플레이를 로드하기 위해 많은 작은 계산을 동시에 실행해야 하는 그래픽 처리를 위해 설계되었습니다. 이러한 기본 아키텍처는 AI 워크로드에도 잘 적용되었습니다. Nvidia는 초기 GPU를 통해 프로그래밍 가능한 셰이더를 개척했으며, 모든 GPU를 프로그래밍 가능한 컴퓨터로 전환하기 위해 CUDA를 출시했습니다.

GPU가 AI에 좋은 이유는 무엇인가요?

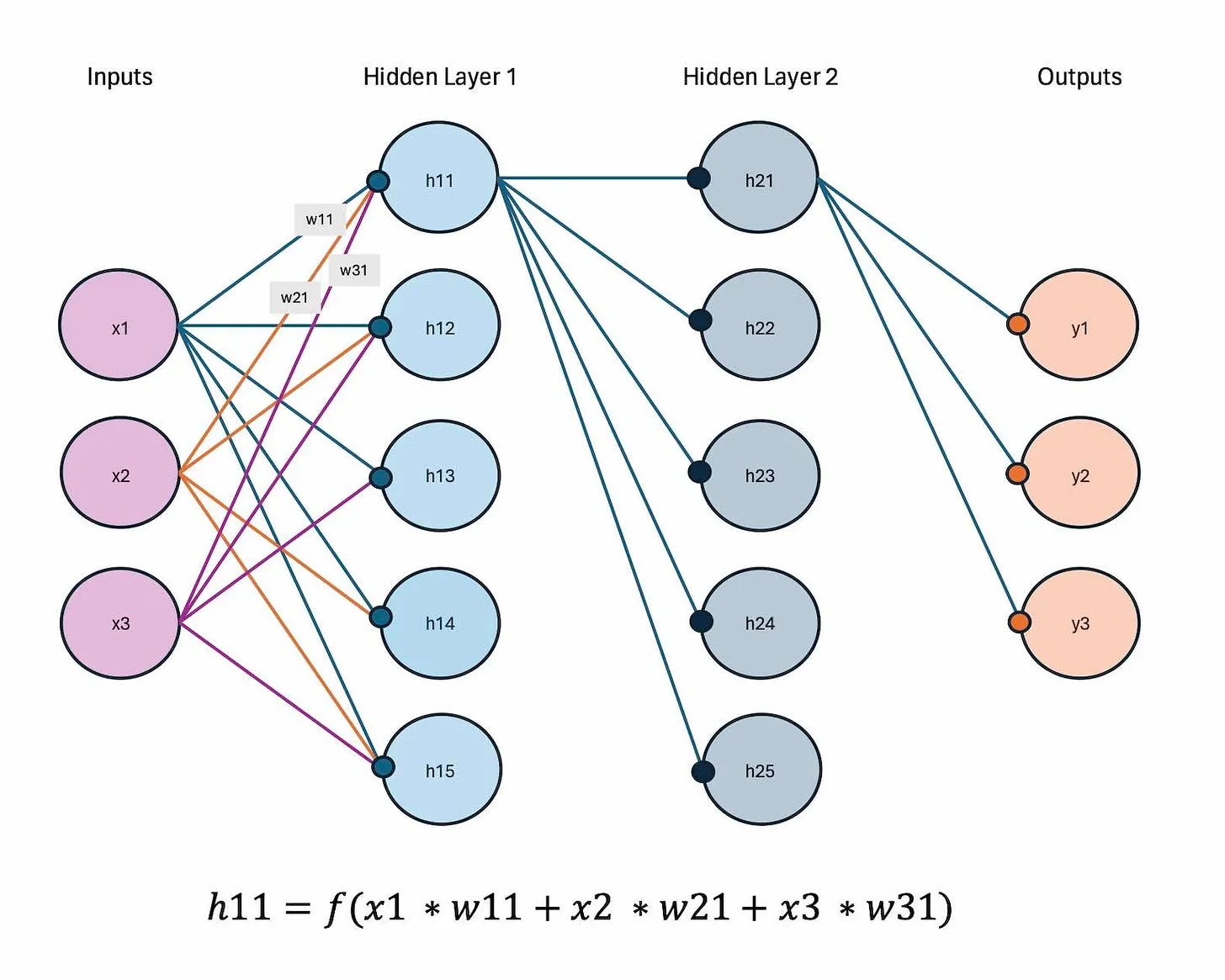

대부분의 AI 모델의 기본 단위는 신경망으로, 각 레이어에 노드가 있는 일련의 레이어입니다. 이러한 신경망은 학습 중인 데이터를 가장 정확하게 표현하기 위해 각 노드에 가중치를 부여하여 시나리오를 표현합니다.

모델이 학습되면 새로운 데이터를 모델에 제공할 수 있으며, 모델은 출력된 데이터가 무엇인지 예측할 수 있습니다(추론).

이러한 “데이터 전달”에는 행렬 곱하기 [(한 레이어, 해당 노드 및 가중치) 곱하기(다른 레이어, 해당 노드 및 가중치)]의 형태로 수많은 작은 계산이 필요합니다.

이 행렬 곱셈은 GPU와 그 병렬 처리 기능에 가장 적합한 애플리케이션입니다.

오늘날의 GPU

GPU는 더 많은 컴퓨팅 성능과 메모리로 계속 커지고 있으며 행렬 곱셈 워크로드에 더욱 특화되어 있습니다.

![[IT] AI 데이터 센터에 대한 입문서, 2부: 에너지 from EricFlaningam](https://substackcdn.com/image/fetch/w_1456,c_limit,f_auto,q_auto:good,fl_progressive:steep/https%3A%2F%2Fsubstack-post-media.s3.amazonaws.com%2Fpublic%2Fimages%2F64f40bf1-71b2-4c53-b141-589e1ae727bd_1272x821.png)

![[IT] 반도체 자본 장비에 대한 입문서 from EricFlaningam](https://substackcdn.com/image/fetch/w_1456,c_limit,f_auto,q_auto:good,fl_progressive:steep/https%3A%2F%2Fsubstack-post-media.s3.amazonaws.com%2Fpublic%2Fimages%2Fc7e64927-168c-4925-ba48-763ddb7dc79e_1400x900.png)