최근 AI 분야에서 가장 흥미로운 연구 중 하나는 Anthrophic의 "On the Biology of a Large Language Model" 입니다.

Autoregresive Transformer 기반의 LLM의 태생적 한계를 나타내기 위해 Next Token Predictor 라는 표현을 씁니다.

입력된 단어에 이어지는 통계적으로 자연스러운 다음 토큰(단어)를 만들어 낼 뿐, 계층적이고 구조적인 생각(Reasoning)은 하지 못한다는 의미지요.

그러나 Anthrophic은 LLM도 생각을 한다고 주장합니다. 신경과학 분야에서 영감을 받아 LLM이 어떻게 생각을 하고 있는지를 분석합니다. 이를 AI 생물학이라 부릅니다.

연구 내용은 매우 흥미롭습니다.

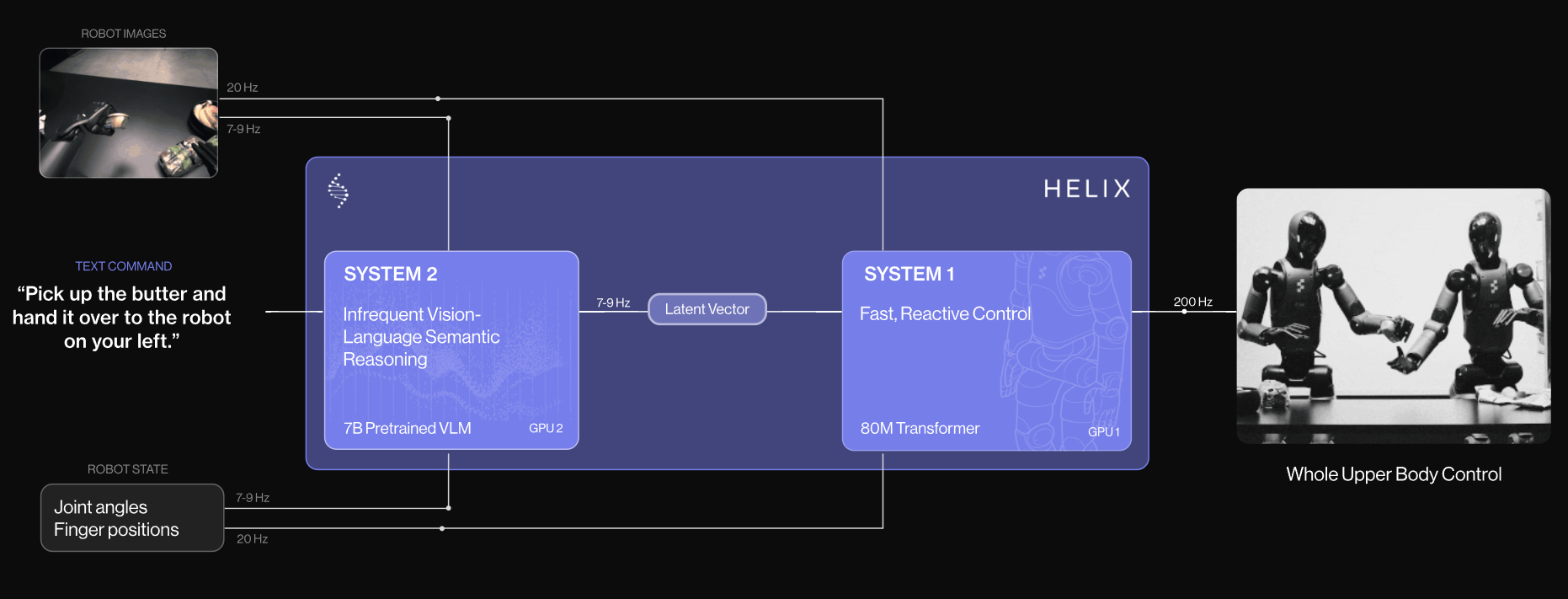

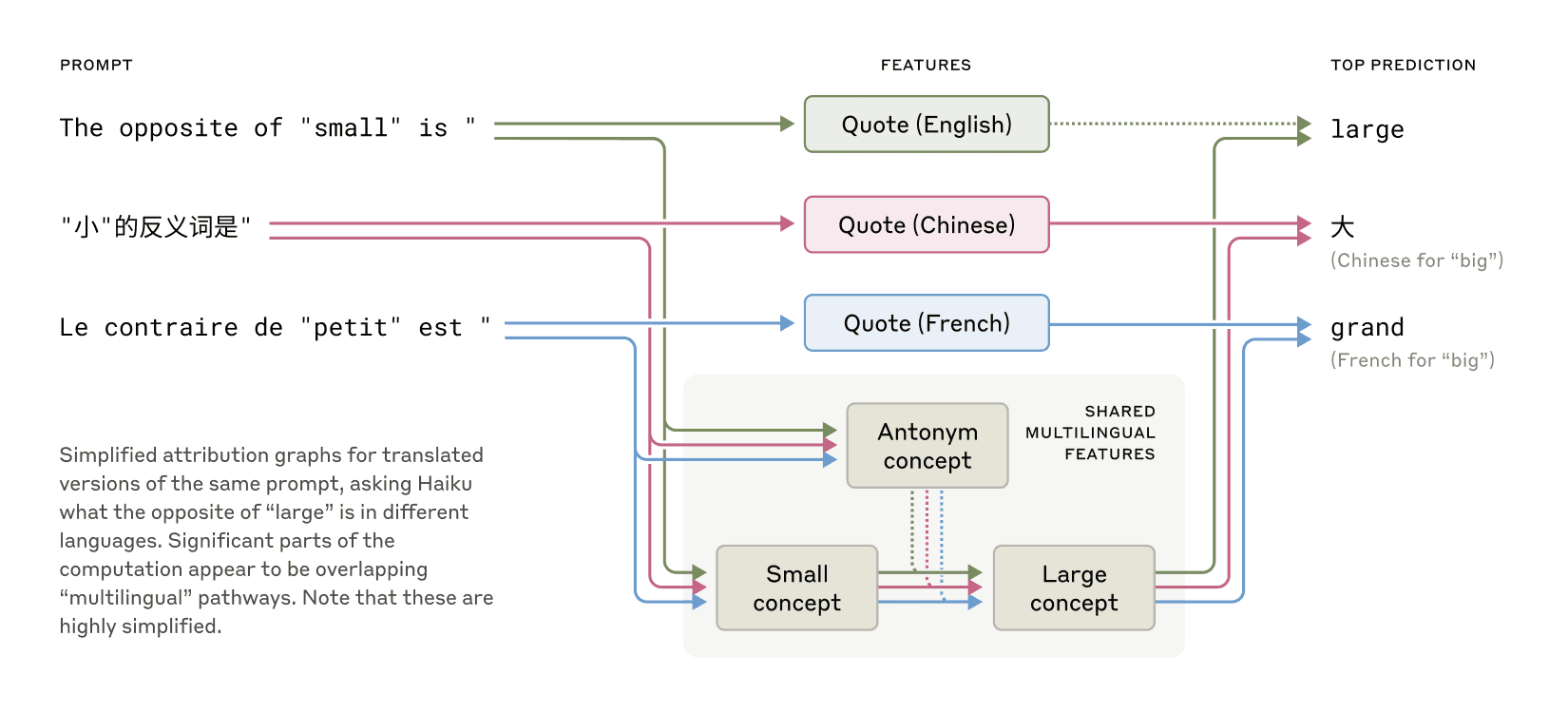

클로드는 때때로 언어 간에 공유되는 개념적 공간에서 생각하는데, 이는 일종의 보편적인 "생각의 언어"가 있음을 시사합니다. 우리는 간단한 문장을 여러 언어로 번역하고 클로드가 이를 처리하는 방식의 중복을 추적하여 이를 보여줍니다.

클로드는 말할 내용을 여러 단어 앞서 계획하고, 그 목적지에 도달하기 위해 글을 씁니다. 우리는 이것을 시의 영역에서 보여줍니다. 시에서는 운율이 맞는 단어를 미리 생각하고, 거기에 도달하기 위해 다음 줄을 씁니다. 이것은 모델이 한 번에 한 단어씩 출력하도록 훈련되었지만, 그렇게 하기 위해 훨씬 더 긴 지평선을 생각할 수 있다는 강력한 증거입니다.

클로드는 때때로 논리적 단계를 따르기보다는 사용자와 동의하도록 설계된 그럴듯하게 들리는 주장을 합니다. 우리는 어려운 수학 문제에 대한 도움을 요청하면서 잘못된 힌트를 제공하여 이를 보여줍니다. 우리는 그것이 가짜 추론을 만들어내는 것을 "실제로 잡아낼" 수 있으며, 우리 도구가 모델에서 우려되는 메커니즘을 표시하는 데 유용할 수 있다는 개념 증명을 제공합니다.

1. 클로드는 어떻게 다국어에 능통한가?

클로드는 영어, 프랑스어, 중국어, 타갈로그어 등 수십 개의 언어를 유창하게 구사합니다. 이 다국어 능력은 어떻게 작동할까요?

<영어, 프랑스어, 중국어는 공통적인 특징을 가지고 있는데, 이는 개념적 보편성이 어느 정도 있음을 나타냅니다.>

클로드에게 "작은 것의 반대"를 요청하여 이를 조사하게 하면, 언어와 관계 없이 회로 내 동일한 핵심 기능이 활성화되며 답변을 생성할 때 질문자의 언어로 번역되는 형태로 동작하는 것으로 보입니다.