최근 LLM(Large Language Model)은 다양한 분야에서 빠르게 확산되고 있습니다. 그에 따라 LLM이 만들어내는 텍스트·이미지·코드 등의 창출물도 기하급수적으로 늘어나는 중입니다.

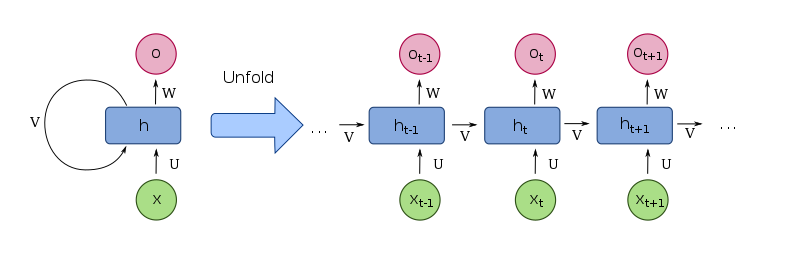

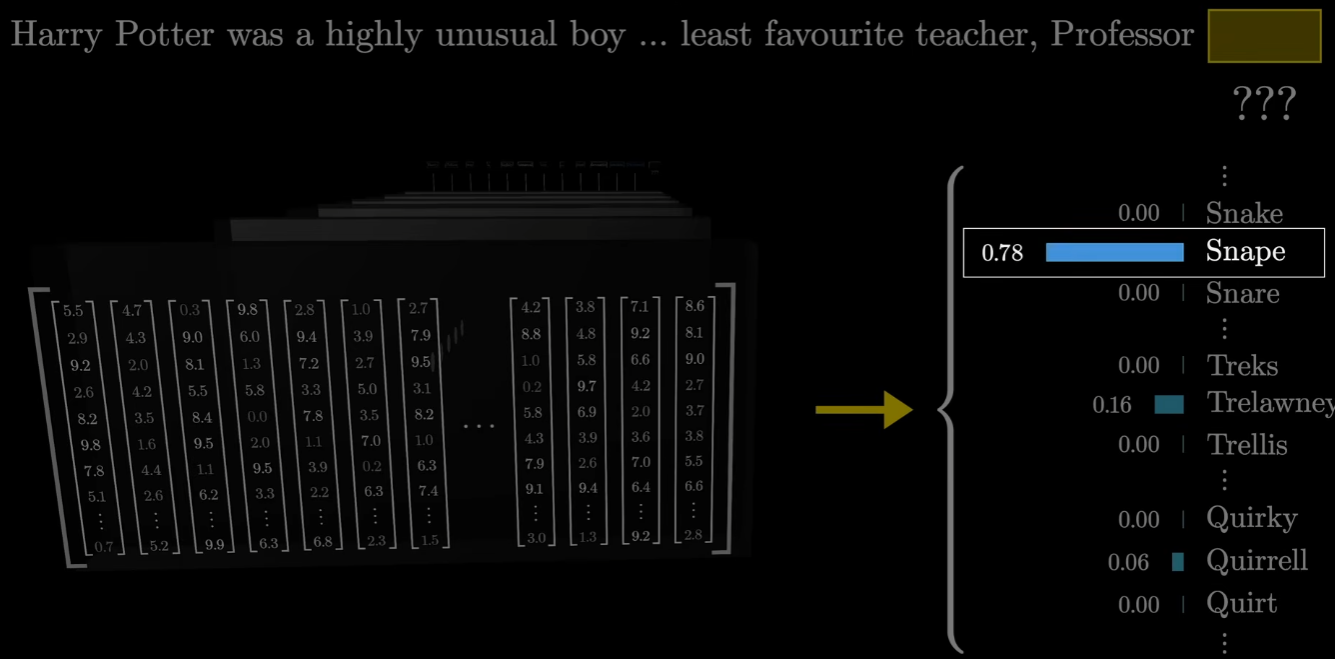

LLM의 학습 방식은 대체로 Transformer 기반으로, 세상 전반에 존재하는 방대한 텍스트 데이터를 학습합니다. 그리고 학습된 분포를 바탕으로 다음에 올 단어(토큰)를 가장 높은 확률로 예측해 문장을 이어 붙이며 출력을 만들어냅니다.

이 구조만 놓고 보면 LLM은 “진보된 사고를 하는 존재”라기보다, 가장 그럴듯하고 평균적인 답에 수렴하도록 설계된 시스템에 가깝습니다. 즉, 특별한 인사이트를 제공하기보다 “대체로 사람들이 납득할 만한 말”을 생성하는 데 초점이 맞춰져 있다고 볼 수 있습니다.

물론 이것만으로도 충분히 유의미합니다. 인간 개인의 경험과 기억이 담을 수 있는 데이터보다 훨씬 큰 규모의 텍스트를 기반으로 답변을 내놓기 때문입니다. 그럼에도 질문은 남습니다.

“LLM이 일반적인 답을 넘어, 더 ‘특별한 인사이트’를 주도록 만들 수 있을까?”

1) ‘성능이 좋은 모델’이란 무엇인가

현재 개발되는 LLM의 목표는 대체로 명확합니다. 성능이 좋은 모델을 만드는 것입니다.

그런데 성능이 좋다는 말은 여러 방식으로 정의될 수 있습니다.

사람들이 더 선호하는 모델

지능이 높은 모델

효용이 높은 모델

정확한 정보를 주는 모델

하지만 훈련 관점에서 보자면, “성능이 좋은 모델”은 결국 평가 지표에서 점수를 잘 받는 모델에 가깝습니다. 모델은 보상(점수)이 주어지는 방향으로 최적화되기 때문입니다.

2) “독특한 답변”에 보상을 주면 인사이트가 생길까?

만약 평가 지표에서 독특한 답을 더 높게 보상한다면, 모델이 그 방향으로 훈련되도록 유도할 수는 있을 것입니다. “평균적인 답”을 피하고, 차별화된 표현과 ...