안녕하세요, 슈크림빵이에요 ☕

오늘은 좀 무거워 보이지만 사실은 엄청 흥미로운 논문 하나를 가볍게 풀어보려고 해요! Anthropic이 2026년 4월에 공개한 "Automated Weak-to-Strong Researcher" 라는 글인데요, 읽다가 "어, 이거 투자하는 입장에서도 꽤 중요한 이야긴데?" 싶어서 정리해두고 싶었어요.

부제는 "AI가 AI를 연구하기 시작했습니다"입니다.

일단, 딱 숫자 하나만 보고 가실게요

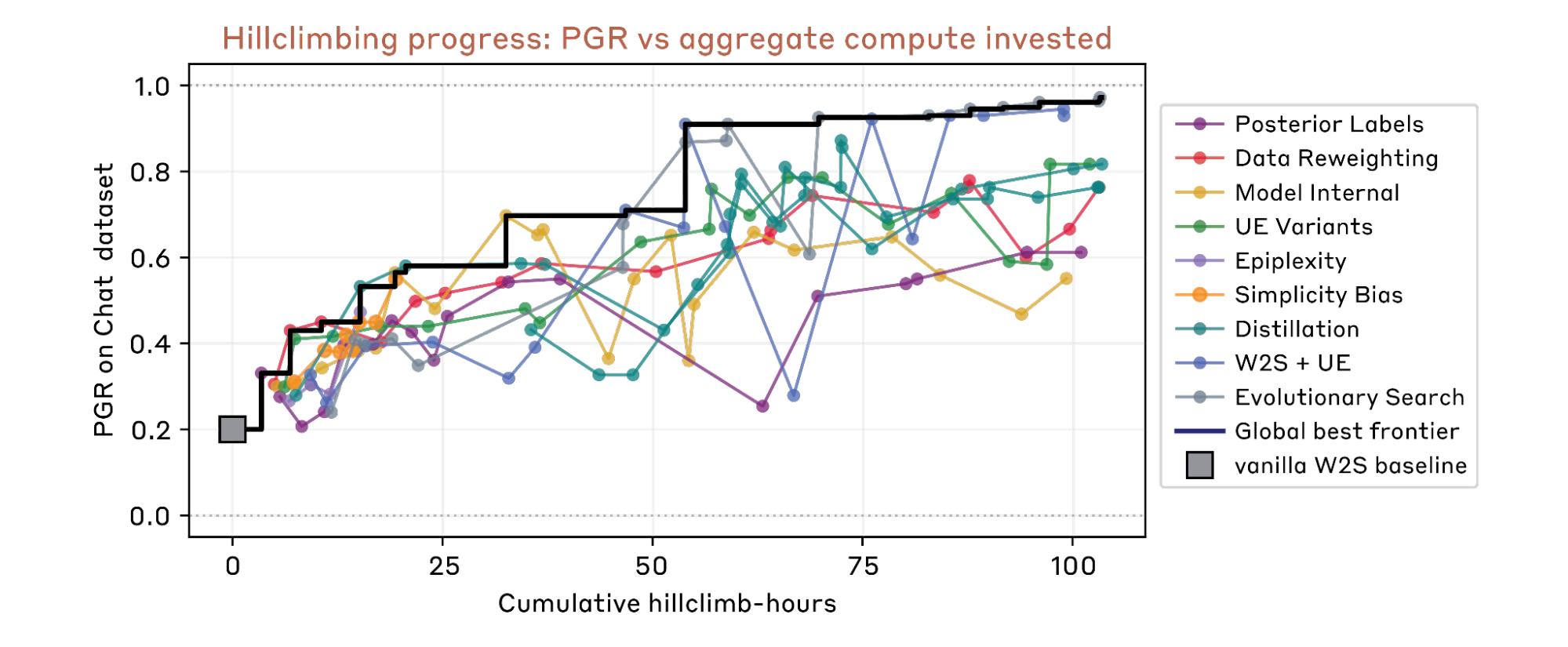

사람 연구자 2명이 7일 동안 매달려서 낸 성적이 0.23. AI 에이전트 9마리가 5일 만에 낸 성적이 0.97. 비용은 약 $18,000 (약 2천4백만 원)이었습니다.

(점수는 1점 만점이에요. 1에 가까울수록 잘한 거예요.)

Figure 1. 9개의 AI 연구자가 시간이 갈수록 점수(PGR)를 점점 올려가는 모습. 회색 네모는 기존 연구의 출발 지점.

무슨 숫자인지, 무슨 문제였는지는 아래에서 천천히 설명드릴게요.

일단은 이거 하나만 기억해주세요!

사람보다 훨씬 빠르고, 훨씬 싸게, 훨씬 잘했다.

그것도 "AI 연구"라는, 원래 똑똑한 박사님들의 영역이라고 여겨지던 분야에서요.

그래서 AI들이 뭘 한 거야?

논문에서 푼 문제는 이름이 좀 어려워요. "Weak-to-Strong Supervision(약→강 지도학습)" 이라고 부르는데요, 풀어서 쓰면 이렇습니다.

나보다 똑똑한 학생을, 나(조금 덜 똑똑한 선생)가 어떻게 잘 가르칠 수 있을까?

이게 왜 중요하냐면요. 지금까지 AI는 사람보다 '덜 똑똑한' 상태였기 때문에, 사람이 AI에게 정답을 알려주면서 가르칠 수 있었어요.

그런데 AI가 사람보다 똑똑해지기 시작하면?

사람은 더 이상 정답을 모르는 문제를 AI에게 가르쳐야 하는 상황이 옵니다. 선생이 학생보다 못하는 상황이요.

이걸 실험실에서 미리 연습해보려고, 연구자들은 일부러 이런 세팅을 만들었습닌다.

작고 약한 AI를 '선생' 역할로

크고 똑똑한 AI를 '학생' 역할로

그리고 선생이 학생을 가르치게 했을 때, 학생이 자기 실력을 얼마나 끌어낼 수 있는지 측정했습니다.

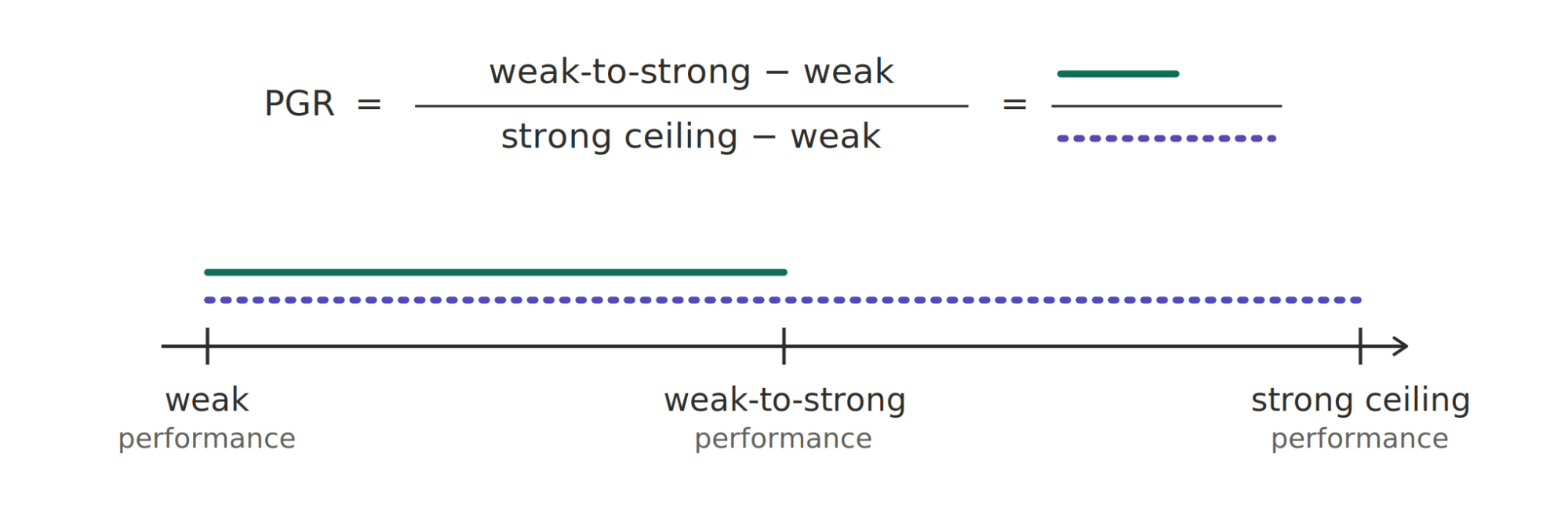

이때 쓰는 점수가 아까 나온 PGR (Performance Gap Recovered, 성능 격차 회복률) 이에요.

0점 = 선생(약한 모델)만큼밖에 못함

1점 = 학생의 진짜 실력을 100% 끌어냄

선생, 학생, 그리고 그 사이의 격차를 보여주는 간단한 도식

사람이 7일을 썼을 때 이 점수가 0.23이었어요. 격차의 23%만 메웠다는 뜻이에요.

그런데 AI들에게 맡겼더니 97%까지 메워버린 거예요.

AI들이 어떻게 연구를 했을까요?

Anthropic이 만든 건 AAR (Automated Alignment Researcher, 자동화된 연구자) 이라는 시스템이에요.

작동 방식은 생각보다 단순합니다.

9명의 AI 연구원을 동시에 고용한다 (각자 자기 컴퓨터 앞에 앉아 있다고 상상하시면 돼요)

각자에게 다른 방향의 연구 주제를 던져준다 ("너는 A쪽으로, 너는 B쪽으로 파봐")

AI들은 스스로 아이디어를 내고 → 실험을 돌리고 → 결과를 보고 → 다시 고치고

서로 공용 게시판에 발견한 ...