안녕하세요, 슈크림빵입니다.🧁

미국이 중국에 AI 칩을 안 팔면, 중국은 어떻게 할까요? 답은 의외로 단순했습니다.

칩을 못 늘리니까, 비트를 쪼갠 거예요.(비트주세요! 드랍 더 비트~)

화웨이가 최근 발표한 HiFloat4라는 4비트 데이터 포맷 이야기인데요, 같은 칩에서 이론상 4배 더 많은 연산을 뽑아내겠다는 전략이에요.

논문 두 편을 중심으로, AI 전문가가 아니어도 따라올 수 있게 정리해보았습니다!

먼저 배경: 왜 비트를 줄여야 하나

AI 모델을 돌리려면 GPU 같은 고성능 칩이 필요합니다.

그런데 미국이 2022년부터 중국에 이 칩을 안 팔고 있어요.

Nvidia H100은 수출 금지, 중국 시장용으로 성능을 낮춘 H20마저 2025년 4월부터 수출 허가가 필요해졌어요.

자체 제조도 쉽지 않아요. 중국 최대 파운드리 SMIC은 7nm 공정에 묶여 있고, Nvidia가 쓰는 4nm TSMC 공정과는 세대 차이가 나요.

화웨이의 2025년 AI 칩 생산량은 약 20만 개로 추정되는데, 이는 미국 생산량의 1~4% 수준이에요.

칩을 더 못 만드니까, 남은 선택지는 하나입니다. 가진 칩에서 더 많이 뽑아내는 것. 그 핵심 기술이 HiFloat4예요.

비트를 줄인다는 게 뭔 말일까요?

AI 모델 안에서는 수많은 숫자(가중치)가 돌아다녀요. 이 숫자 하나를 표현하는 데 몇 비트를 쓰느냐가 정밀도예요.

BF16 (16비트): 현재 표준. 숫자 하나에 16비트.

FP8 (8비트): 절반으로 줄임. 이미 상용화됨.

FP4 (4비트): 또 절반. 같은 칩에서 이론상 4배 연산, 4배 메모리 절약.

당연히 비트가 줄면 숫자를 덜 정확하게 표현하니까 모델 성능이 떨어져요. 핵심은 "얼마나 적은 손실로 4비트를 쓸 수 있느냐"예요.

기존 4비트 포맷들: 뭐가 문제였나

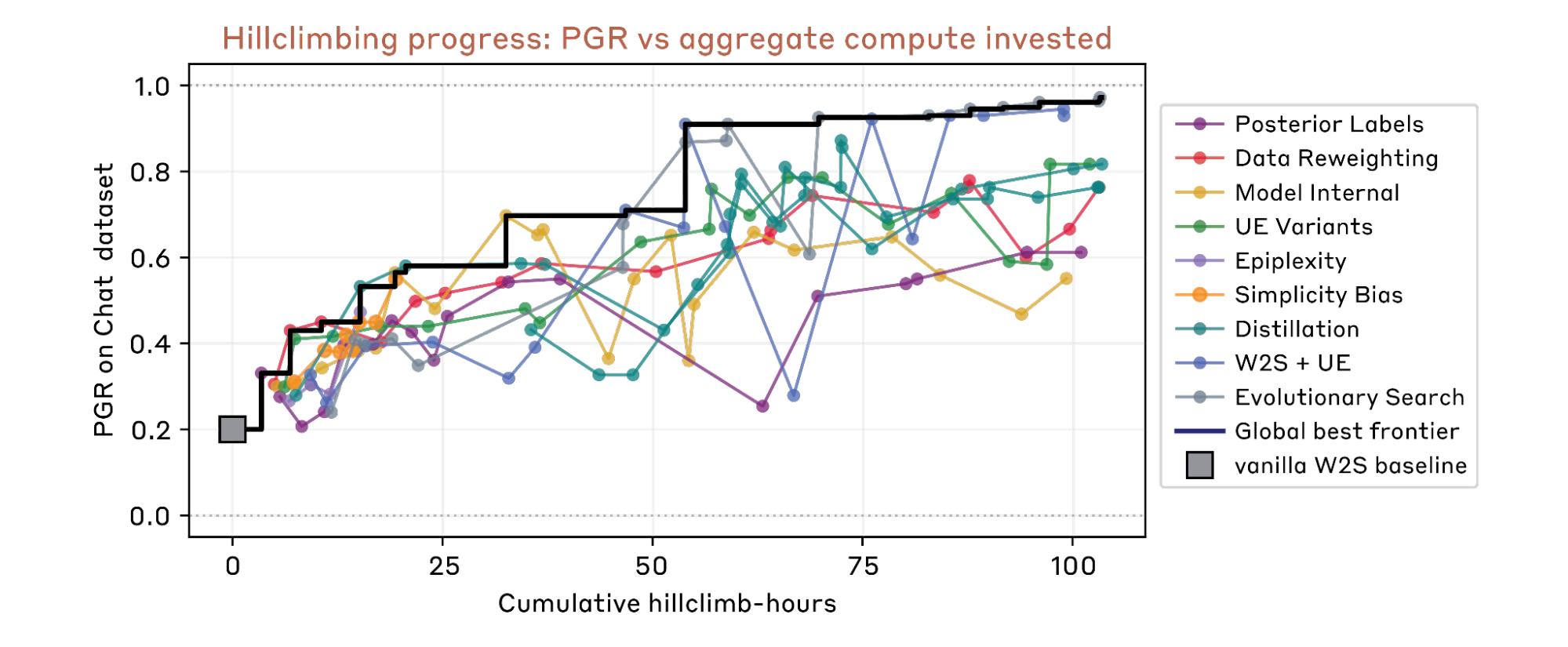

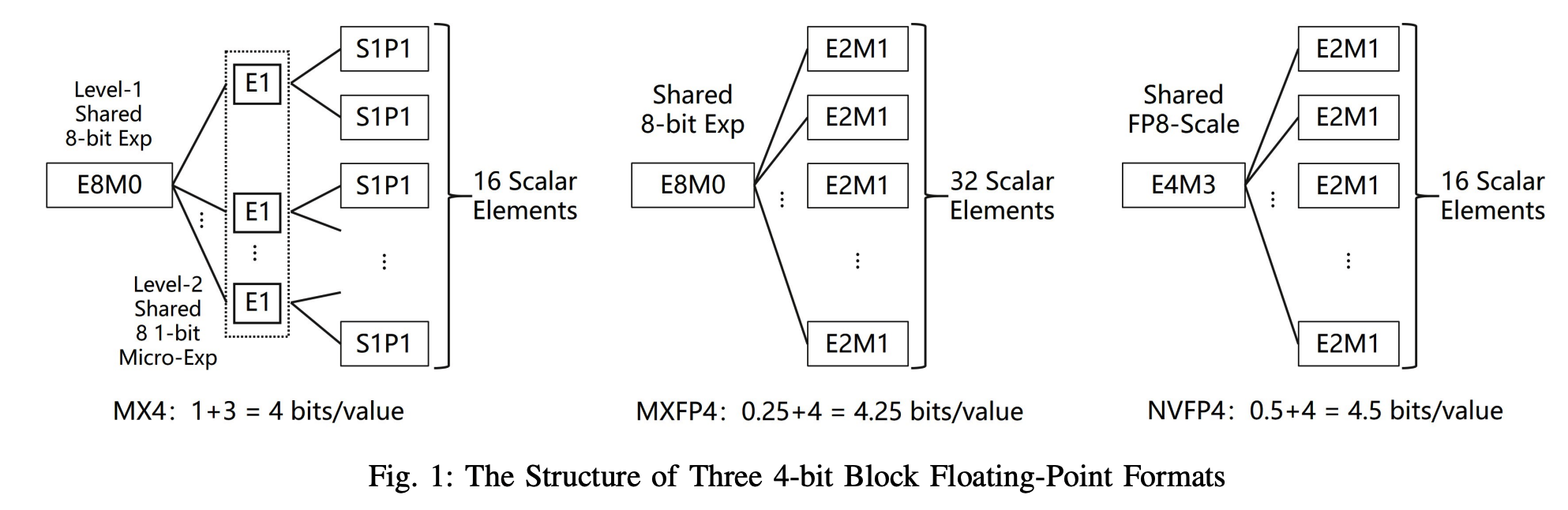

HiFloat4 이전에도 4비트 포맷 시도가 있었어요. 논문에서 세 가지를 비교하고 있어요.

세 가지 4비트 BFP 포맷(MX4, MXFP4, NVFP4)의 구조를 나란히 비교한 그림. 각 포맷이 숫자를 어떤 식으로 쪼개서 저장하는지 보여줍니다.

MX4 (Microsoft/Meta)

그룹 크기가 16개로 작고, 메타데이터 오버헤드가 커서 실제 데이터를 3비트로 줄여야 했어요. 결과적으로 정밀도가 너무 낮아서 AMD도 채택을 포기.

MXFP4 (Open Compute Project)

Nvidia, AMD, 화웨이까지 채택한 업계 표준. 그룹 크기를 32로 늘리고 개선했지만, 가중치(weight)에만 쓸 수 있고 활성화(activation)에는 정밀도가 부족해요. 즉 4비트 연산력의 절반만 활용 가능.

NVFP4 (Nvidia Blackwell)

활성화에도 쓸 수 있게 만든 Nvidia의 독자 포맷. 하지만 두 가지 대가가 있어요. 첫째, 다이나믹 레인지가 좁아서 소프트웨어로 추가 스케일링(PTS)을 해야 하고, 둘째, 그룹 크기가 16으로 작아서 행렬 연산 시 하드웨어 오버헤드가 큼.

정리하면, 기존 포맷들은 정밀도, 다이나믹 레인지, 하드웨어 효율 세 마리 ...