LLM과 Diffusion 은 매우 유용한 기술입니다.

특히 CoT와 RAG 이후 LLM의 역량은 빠르게 성장했고, 다양한 분야에서 활용되고 있습니다.

Workflow가 고정된 반복적인 작업이나, 거대한 Database에서 필요한 것을 찾거나, 특정한 포멧에 맞춰 문서를 작성하는 일은 이미 인간을 대체하고 있습니다. AI 기업들은 AI 리서처를 뽑는 동시에 Staff나 SW 엔지니어를 해고하고 있습니다.

현재 일어나는 상황만 보면 빠른 시일내에 AGI에 도달하고, AI 기업이 폭발적인 성장을 보일 것이라고 생각하기 쉽습니다.

그러나, AGI 도달은 생각보다 더 많은 시간이 걸릴 수 있습니다.

OpenAI는 Stargate Project에 4년 내 $500B 나 투입 예정이고,

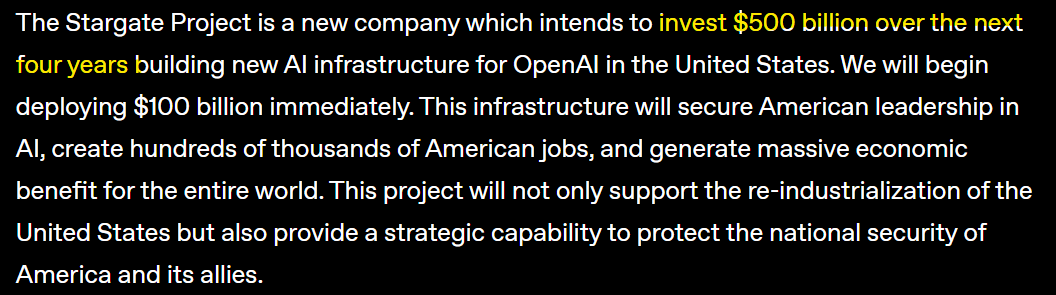

XAI의 데이터 센터는 5년 내 5000만장 규모가 될 것이며,

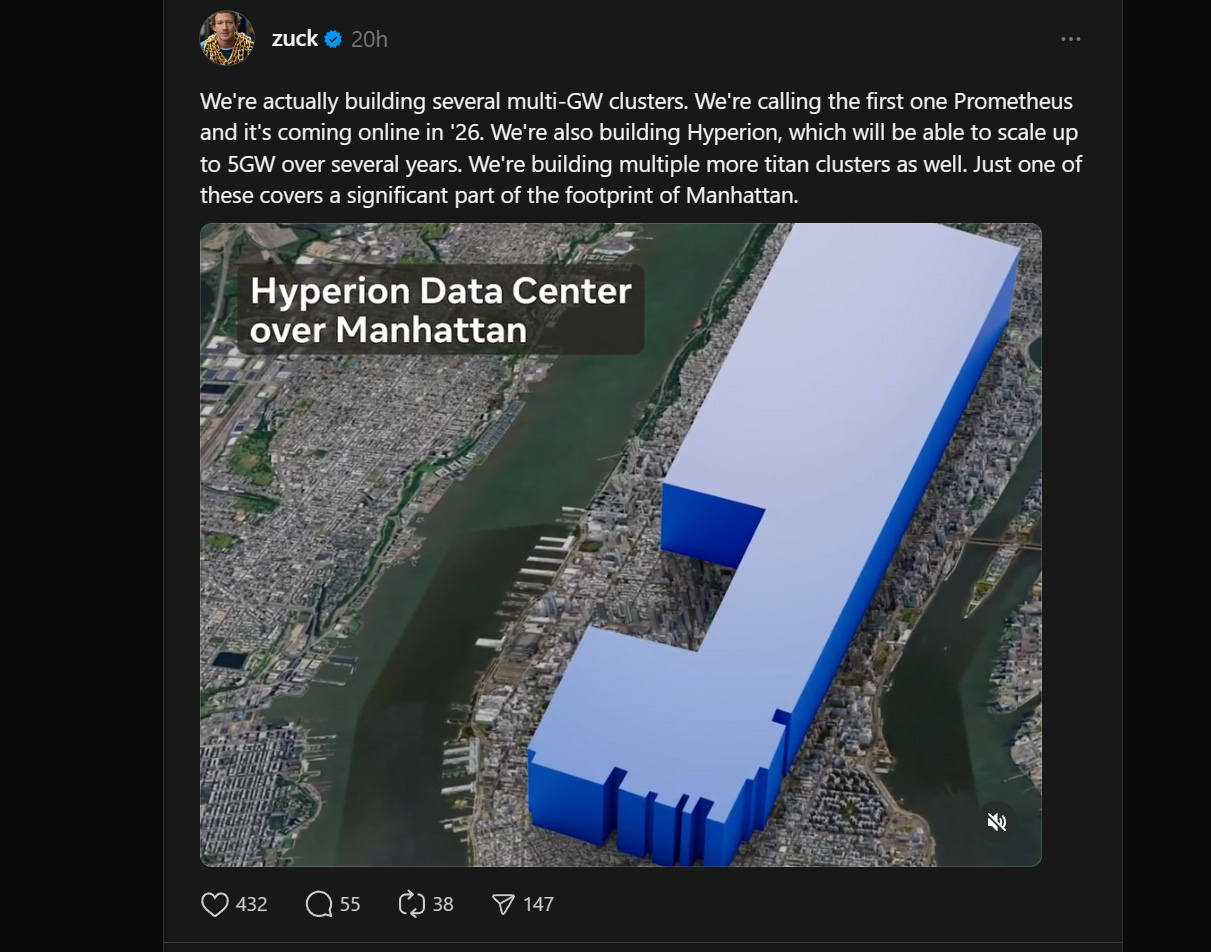

Meta 는 수년 내 5GW급 Datacenter를 지을 것이라는 계획에서 잘 드러납니다.

AI 리더 중 그 누구도 지금의 스케일로 다음 세대의 AI를 만들 수 있다고 믿지 않습니다.

Jenson Huang은 최근 인터뷰에서 수년 내 GPU의 과잉공급이 발생할 가능성은 매우 낮다고 했습니다.

이는 두가지를 의미합니다.

수 T$ 수준의 인프라 투자가 정당화 될 만큼 AGI에 대한 확신이 존재한다.

다만 ROI, 알고리즘 개발 속도를 고려할 때, 2~5년의 시간이 필요하다.

LLM은 태생적인 한계가 존재합니다. 다양한 층위에서 한계점을 이야기 할 수 있지만, Meta FAIR의 Yann LeCun의 말을 빌리면 다음과 같은 문제가 있습니다.

Yann LeCun argues that Large Language Models (LLMs) are limited because they lack true reasoning, understanding of the physical world, and persistent memory, instead relying on superficial pattern matching rather than deeper cognitive processes.

LLM이나 Diffusion 모델은 단어나 픽셀의 RGB와 같은 표현형을 배웁니다. VLM은...